Si has oído que el 2 de agosto de 2026 te cae encima el régimen de alto riesgo del Reglamento Europeo de IA, enhorabuena: ya estás desactualizado. Esas obligaciones se retrasaron a finales de 2025, el Parlamento Europeo lo respaldó en marzo de 2026, y ahora no aplican hasta diciembre de 2027 o agosto de 2028, según el caso.

Pero otras sí llegan el 2 de agosto de 2026. Y, sobre todo, hay una obligación que lleva en vigor desde febrero de 2025 que casi ninguna pyme española conoce.

Este artículo es lo que hemos aprendido intentando entender qué aplica, qué no, y qué toca hacer.

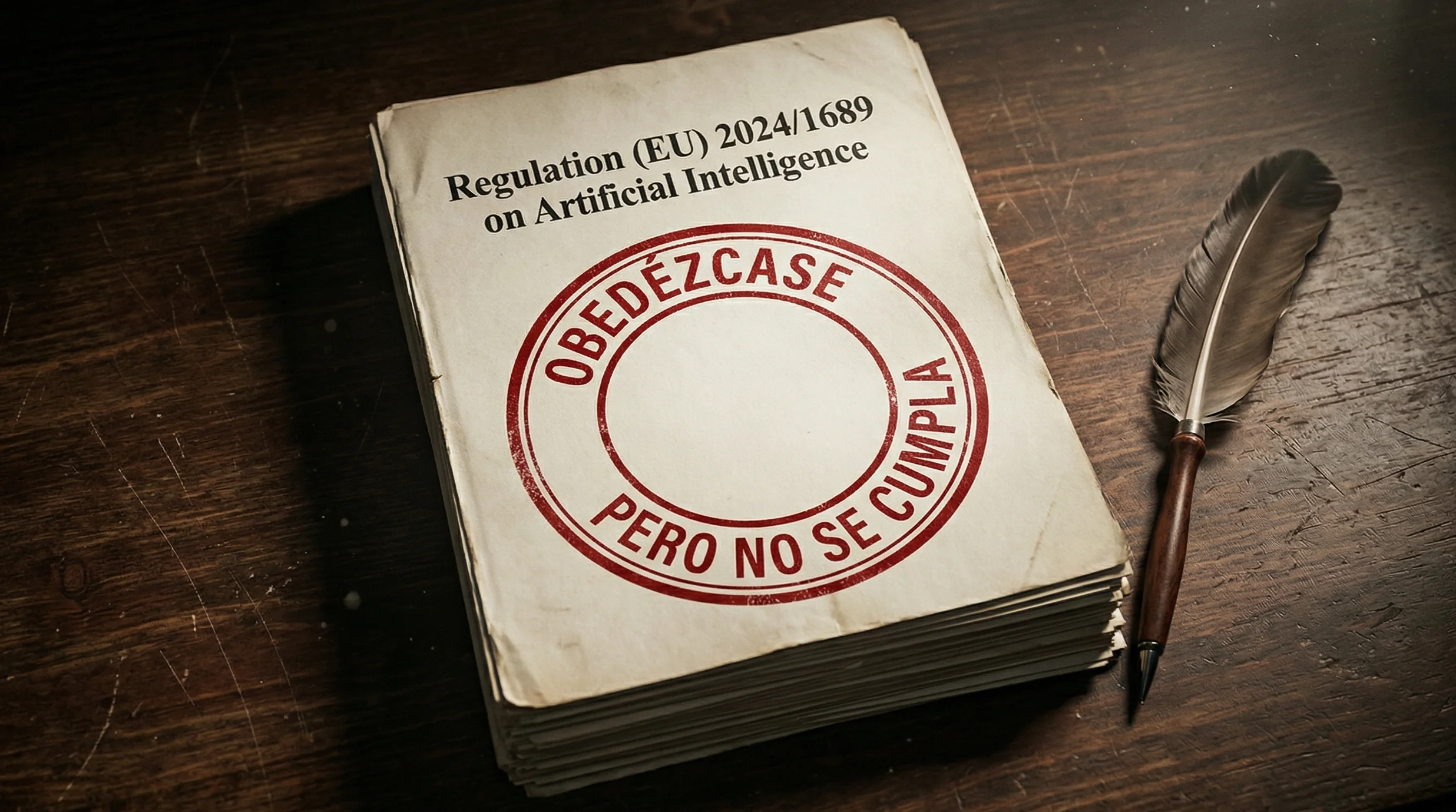

Obedézcase pero no se cumpla

En 1528, cuando una orden real española llegaba a las Indias y era impracticable, el virrey o gobernador seguía un procedimiento: cogía la orden, la besaba, la ponía sobre su cabeza como señal de obediencia a la Corona, y pronunciaba la fórmula jurídica "obedézcase pero no se cumpla".

La orden quedaba reconocida como válida. No se iba a aplicar, porque al llegar al destino no tenía sentido.

No era rebeldía. Era una institución legal, incorporada al propio derecho castellano. La Corona sabía perfectamente que desde Madrid, con nueve meses de travesía y un océano de por medio, sus órdenes llegaban a veces a un mundo que no coincidía con las suposiciones de la corte. La fórmula era lo que mantenía funcional un imperio que, de otro modo, se habría paralizado.

Quinientos años después, Bruselas está pasando por el mismo proceso con el Reglamento de IA.

Qué es el AI Act, y por qué ya se ha retrasado

El Reglamento Europeo de Inteligencia Artificial se aprobó en agosto de 2024. Tiene 180 páginas, 113 artículos y 13 anexos. Seguramente, solo lo hayan leído IAs. Pobres.

Se diseñó para entrar en vigor por fases, como suele pasar cuando Bruselas legisla primero y piensa después:

- 2 de febrero de 2025: prácticas prohibidas (puntuación social, manipulación, etc.) y obligación de alfabetización en IA

- 2 de agosto de 2025: gobernanza y obligaciones para proveedores de modelos IA generales

- 2 de agosto de 2026: transparencia y aplicabilidad general

- 2 de agosto de 2027: sistemas de alto riesgo

Hasta aquí, el plan.

Luego llegó la realidad. Los estándares técnicos no estaban listos. Las autoridades nacionales no estaban listas. Las empresas no estaban listas. Todos excepto el texto del Reglamento, que seguía ahí, con sus fechas, impasible.

El 19 de noviembre de 2025, la Comisión publicó el Digital Omnibus on AI, un paquete llamado "de simplificación", aka "vamos a mover las fechas hacia adelante". El 23 de marzo de 2026, el Parlamento Europeo lo respaldó. Resultado:

- Las obligaciones para sistemas de alto riesgo independientes se retrasan a 2 de diciembre de 2027

- Las obligaciones para sistemas de alto riesgo embebidos en productos se retrasan a 2 de agosto de 2028

Es decir: el titular "en agosto de 2026 te cae encima el régimen de alto riesgo" ya no es verdad. Lo que sí llega ese día es otra cosa. Y para la mayoría de las pymes, una cosa bastante manejable.

Lo que hace una pyme normal no es "alto riesgo"

Antes de entrar en obligaciones, lo primero es saber en qué categoría caes.

El Reglamento clasifica los sistemas de IA en cuatro niveles: prohibidos, alto riesgo, riesgo limitado y riesgo mínimo. El "alto riesgo" es el que asusta a la gente en las charlas. Pero lo que cuenta como alto riesgo está bastante delimitado en el Anexo III:

- Identificación biométrica

- Infraestructura crítica (redes eléctricas, transporte)

- Educación (selección de alumnos, puntuación de exámenes)

- Empleo (reclutamiento, evaluación del rendimiento)

- Acceso a servicios esenciales (crédito, ayudas públicas, triaje sanitario)

- Aplicación de la ley, migración, justicia

Si tu empresa automatiza la clasificación de correos, procesa facturas, responde consultas de clientes, cruza datos entre sistemas o genera borradores de escritos, no estás en ninguna de esas categorías. Estás en "riesgo limitado" o "riesgo mínimo", con obligaciones muy ligeras.

La excepción importante para muchas pymes es reclutamiento y evaluación del rendimiento. Si usas IA para filtrar currículos o para evaluar empleados, ahí sí entras en alto riesgo. Pero entonces tienes hasta diciembre de 2027 gracias al Omnibus, y mientras tanto los estándares siguen sin estar listos.

Lo que sí aplica ya: alfabetización en IA

La parte que casi nadie conoce.

El artículo 4 del Reglamento está en vigor desde el 2 de febrero de 2025. Dice, en resumen, que toda empresa que use sistemas de IA debe garantizar que su personal tenga un "nivel suficiente de alfabetización en IA", proporcional a su puesto.

En la práctica: si en tu empresa hay gente usando ChatGPT, Copilot, un CRM con IA, o cualquier automatización con un modelo detrás, esa gente tiene que entender mínimamente qué hace la herramienta, cuáles son sus límites y dónde puede equivocarse. Y tú, como empresa, debes poder demostrar que lo has enseñado.

No es un máster. Es una formación proporcional, documentada, adaptada al puesto. Un par de horas bien hechas con ejemplos concretos suele ser suficiente para roles no técnicos.

Esta obligación lleva más de un año en vigor y la mayoría de las pymes españolas ni siquiera sabe que existe. Y la AESIA ya puede sancionarlo.

Lo que llega el 2 de agosto de 2026: transparencia

Esta es la fecha que sí te interesa.

El artículo 50 introduce obligaciones de transparencia para sistemas de "riesgo limitado". Los tres que afectan a una pyme típica:

- Chatbots: si tienes un bot de atención al cliente basado en IA, el usuario debe saberlo. No vale camuflarlo de persona. Suele bastar con una frase en el primer mensaje.

- Contenido generado por IA: si publicas imágenes, audio, vídeo o texto generado por IA, debes identificarlo como tal. El formato está siendo definido (la Comisión publicó un borrador en diciembre de 2025, código final previsto para junio de 2026).

- Deepfakes: cualquier contenido que imite a personas reales debe marcarse como artificial.

Cumplirlas no requiere consultoría cara. Un aviso claro en el lugar correcto suele ser suficiente.

AESIA: la agencia que ya está operando

En España no tenemos un OpenAI o un Anthropic, pero hemos sido el primer país de la UE en crear su autoridad nacional de IA (cómo no). La Agencia Española de Supervisión de la Inteligencia Artificial (AESIA) está basada en A Coruña, y según datos públicos de marzo de 2026 tiene:

- 120 inspectores

- 42 millones de euros de presupuesto para 2026

- 23 investigaciones preliminares abiertas

Repartamos: 23 investigaciones entre 120 inspectores salen a 0,19 investigaciones por inspector. Un ritmo frenético, vamos. Pero es señal de que la agencia existe, está contratando, y eventualmente va a fiscalizar.

La mayoría de esos inspectores no han entrenado un modelo de IA en su vida. Pero van a evaluar si los tuyos están bien entrenados.

Un dato a tener en cuenta es que, según el INE, solo el 2,9% de las pymes españolas usan IA. Si todas decidieran usarla mañana, cada inspector tendría que auditar aproximadamente 25.000 empresas. La buena noticia: no todas la usan. La mala: la minoría que sí la usa está todavía mayoritariamente sin cumplir el artículo 4.

Sanciones: 35 millones no es para ti

Los titulares hablan de multas de hasta 35 millones de euros o el 7% de la facturación global. Es cierto, pero para pymes el Reglamento aplica una regla específica: se paga la menor de las dos cifras, no la mayor.

Haz el cálculo mental con tu facturación:

- Facturación 500.000 €: máximo para la infracción más grave (7%) = 35.000 €

- Facturación 2 millones: máximo = 140.000 €

- Facturación 10 millones: máximo = 700.000 €

No son cifras cómodas, pero tampoco son "el fin de tu empresa". Y las infracciones graves requieren cosas como usar IA para puntuación social masiva, no que se te olvide etiquetar un chatbot.

Qué hacer ya, sin pagar un consultor

Lo concreto, en orden:

- Lista de sistemas IA en uso: ChatGPT, Copilot, herramientas del CRM, automatizaciones, todo. Saber qué hay es el primer paso.

- Formación documentada (artículo 4): para cada rol que use IA, una formación básica con contenidos y fecha. Un par de horas con material propio suele bastar. Guarda registro.

- Revisar chatbots y contenido IA: si tienes alguno, añade avisos. El texto no tiene que ser elegante, solo claro.

- Seguimiento del Omnibus: las fechas de alto riesgo se están moviendo. Si haces reclutamiento o evaluación con IA, vigila el calendario definitivo.

Cierre

Cinco siglos después de los virreyes de Indias, Europa se enfrenta al mismo problema que Felipe II: legislar desde un centro sobre una realidad que cambia más rápido que los documentos que la regulan. La diferencia es que ahora la Corona es la Comisión Europea, y en lugar de galeones tenemos borradores, paquetes de simplificación y códigos de buenas prácticas publicados con meses de retraso.

El AI Act va a aplicarse. Ya aplica parcialmente. Pero va a aplicarse a trompicones, con retrasos, con modificaciones que llegan antes de que la norma original entre en vigor.

Para una pyme que automatiza procesos con IA, la estrategia no es esperar. Tampoco correr a cumplir lo que todavía se está reescribiendo. Es entender el marco, hacer lo que ya aplica (que es poco y manejable), y tener el resto preparado.

En Veltas diseñamos los sistemas pensando en esto desde el principio. Transparencia integrada, registros de actividad, revisión humana en los puntos que importan, y formación documentada para el equipo que los va a usar. No porque venga un inspector mañana. Porque cuando venga, dentro de un año, dos o cinco, no queremos estar reescribiendo todo.

Si tu empresa está usando IA y no sabes en qué categoría cae, o quieres preparar el cumplimiento mínimo sin montar una consultora paralela, es lo primero que miramos en una auditoría.

Auditoría gratuita, sin compromiso. Te decimos qué aplica, qué no, y qué haríamos nosotros.